Dans sa revue des cinq grands enjeux de l’intelligence artificielle, le journal “Polytechnique insight” note l’importance de “justifier les décisions prises par un algorithme”(1), ce qu’on peut tout à fait rapprocher de la notion d’explicabilité du code qui se définit comme suit : “capacité de mettre en relation et de rendre compréhensible les éléments pris en compte par le système pour la production d’un résultat.” (2). Cette notion prend une importance croissante avec le développement de l’intelligence artificielle, en témoigne le rapport Villani (2018) et son intégration à la stratégie européenne en matière d’intelligence artificielle4 (3). La notion est d’ailleurs existante dans le droit français, les algorithmes de service public déjà évoqués sont en effet, au même titre que les agents, redevables de leurs actions. “Les administrations qui conçoivent et utilisent des algorithmes publics doivent donc “rendre des comptes” de leur utilisation auprès des individus concernés, mais aussi de la société dans son ensemble.”(4).

Le rapport “Flexible and Context-Specific AI Explainability: A Multidisciplinary Approach” écrit par Valérie Beaudouin, Isabelle Bloch et al. (5) distingue quatre facteurs d’explicabilité qui permettent de moduler son niveau contextuellement. Le destinataire (utilisateur, régulateur, expert…) ; le niveau de criticité de l’algorithme (besoins différents entre expliquer les raisons d’un crash de voiture autonome et les résultats de Google) ; le cadre légal et l’environnement de déploiement (application critique, besoin d’un usage facilité au maximum, etc.). Isabelle Bloch, titulaire de la chaire en intelligence artificielle de Sorbonne université, note (propos recueillis par Sophy Caulier) (6) à ce propos : “Je travaille, par exemple, avec des médecins-radiologues sur la mesure de l’épaisseur du corps calleux chez les prématurés. Les radiologues voulaient savoir d’où venaient les scores obtenus, quelle région avait été reconnue dans l’image, où avaient été faites les mesures, pour comprendre ce qui avait contribué à la décision et expliquer le résultat final. Ces étapes étaient nécessaires pour qu’ils aient confiance dans l’outil.”

De la même façon, dans le cas patrimonial, un chercheur souhaitant écrire un article sur l’iconographie de Clytemnestre dans Gallica souhaitera savoir pourquoi et comment le RAG fonctionne pour identifier les éventuelles lacunes et biais (par exemple l’oubli d’un vase grec où elle n’est représentée que de façon incertaine) ; une personne cherchant simplement à consulter une image de la femme d’Agamemnon sera satisfaite du résultat sans avoir besoin de comprendre ses tenants et aboutissants. Il s’agit donc de trouver, parmis des milliards de paramètres d’entrée, celui qui aura influencé le résultat d’une requête ou d’une recommandation. Cette problématique rejoint totalement celle posée depuis le début de ce mémoire autour de la notion de découvrabilité. Dans les deux cas, le niveau d’explicabilité requis va dépendre des quatre facteurs cités plus haut.

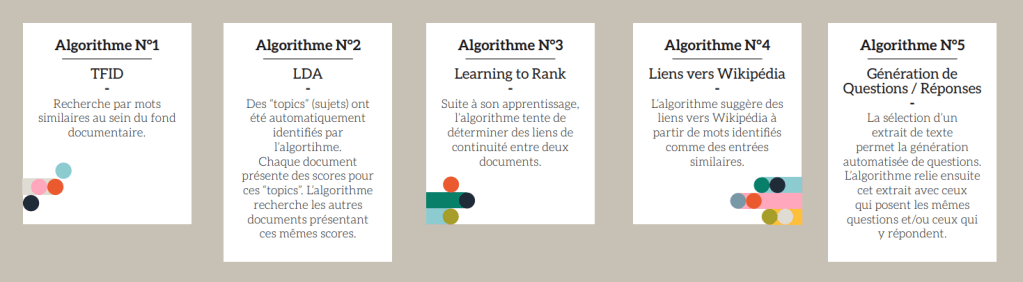

L’explicabilité est l’un des enjeux pris en compte dans le projet Archival, qui vise à poser la question du rôle de l’intelligence artificielle dans l’interprétation de fonds d’archives (7). Son principe est de créer une interface de résultats alimentée par l’intelligence artificielle qui donnerait à voir, en plus des résultats à proprement parler, le processus de génération (8). Cinq algorithmes sont mis à disposition du chercheur qui devra sélectionner celui adapté à son cas d’usage, ils sont vus comme “les outils de la suite bureautique” (9) choisis par les utilisateurs en connaissance leurs fonctionnements et leurs avantages.

Depuis : Agnola, Azémard, de Silva

L’approche est dite de la “boite transparente” (glass box)(10), dans laquelle l’enjeu n’est plus uniquement le résultat, mais le processus qui y mène (11). L’objectif pour l’équipe du projet est d’expliquer en détail ce que fait chaque algorithme pour que les usagers comprennent les biais et problématiques posées. De même qu’on a appris que pour trouver le journal “le voleur” dans un moteur de recherche il fallait, pour éviter les problématiques d’homonymie ajouter, “journal” à notre requête, les chercheurs auront à apprendre les biais et problématiques de l’intelligence artificielle grâce à une démarche d’explicabilité des projets. Cette notion est donc autant du côté des producteurs et des créateurs d’interfaces qui doivent les rendre les plus transparentes possibles que du côté des utilisateurs qui doivent s’acculturer au numérique et comprendre ses écueils. On a là un exemple d’explicabilité dite globale, c’est-à-dire que ce qui est donné à comprendre à l’usager est le fonctionnement général de l’algorithme, à la différence du niveau local où on expliquerait chacune des décisions que ce dernier prendra (12).

Notes

- Isabelle Bloch, Les nouveaux enjeux de l’IA, Polytechnique Insights, 2021, url : https : / /www.polytechnique- insights.com/dossiers/digital/les- nouveaux- enjeux- de- lia/ (visité le 19/08/2024).

- Explicabilité (IA), url : https://www.cnil.fr/fr/definition/explicabilite-ia (visité le 19/08/2024).

- Winston Maxwell, « Comment améliorer l’explicabilité et la responsabilité des algorithmes ? », Les cahiers Louis Bachelier (, 2020), p. 14.

- Les algorithmes publics : enjeux et obligations | guides.etalab.gouv.fr, url : https://guides.etalab . gouv . fr / algorithmes / guide / # _ 2 – les – enjeux – des – algorithmes – publics (visité le19/08/2024).

- Valérie Beaudouin, I. Bloch, David Bounie, Stéphan Clémençon, Florence d’Alché-Buc, James Eagan, W. Maxwell, Pavlo Mozharovskyi et Jayneel Parekh, Flexible and Context-Specific AI Explainability : A Multidisciplinary Approach, mars 2020, doi : 10.48550/arXiv.2003.07703, arXiv : 2003.07703 [cs] in W. Maxwell, « Comment améliorer l’explicabilité et la responsabilité des algorithmes ? »…p. 14

- I. Bloch, Les nouveaux enjeux de l’IA…

- Valorisation d’archives multimédia : Compréhension automatique multimodale du langage pour de nouvelles interfaces intelligentes de médiation et de transmission des savoirs, Agence nationale de

la recherche, url : https://anr.fr/Projet-ANR-19-CE38-0011 (visité le 19/08/2024) in Penser la découvrabilité des contenus culturels… - Éléonore Besnehard, « Évaluer une interface documentaire augmentée : étude de cas sur le projet ANR Archival », p. 46.

- Michel Agnola, Ghislaine Azémard et Samuel da Silva, « IA et SHS : un dialogue indispensable », dans EUTIC 2022 “ A l’intersection de l’art, de la science et de la technologie : dialogues entre les hommes et les machines ”, Corfou, Greece, 2022, url : https://hal.science/hal-04220079 (visité le 19/08/2024), p. 9.

- Par opposition à l’effet boite noire (black box) souvent décrit pour évoquer la difficulté de compréhension

des processus liés à l’intelligence artificielle. - É. Besnehard, « Évaluer une interface documentaire augmentée : étude de cas sur le projet ANR Archival »…, p. 47.

- W. Maxwell, « Comment améliorer l’explicabilité et la responsabilité des algorithmes ? »…, p. 15.

Laisser un commentaire